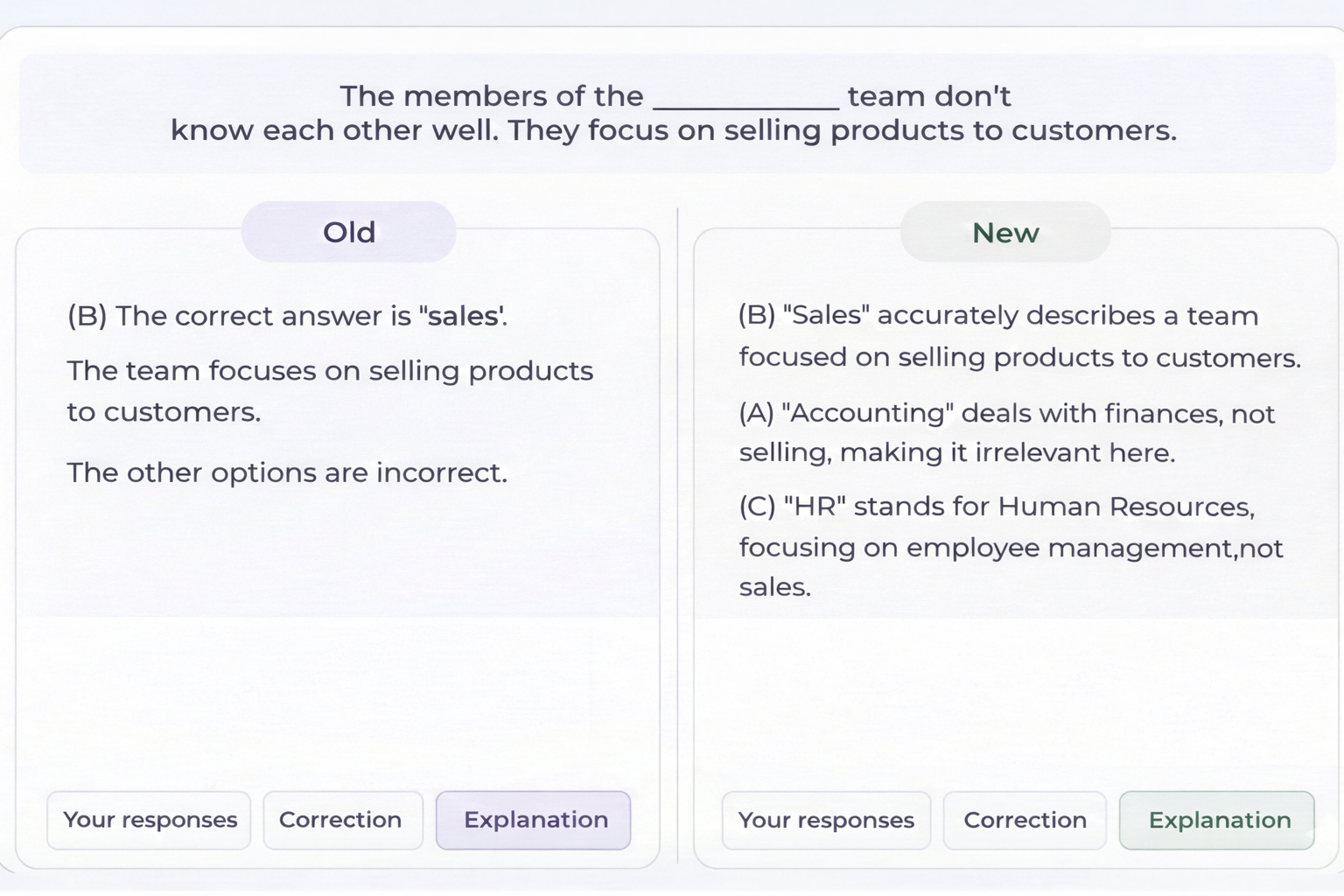

Apprendre ne se résume pas à choisir la bonne réponse à un exercice.

C’est comprendre pourquoi elle est correcte et pourquoi les autres ne le sont pas.

Cette compréhension exige des explications pédagogiques précises et structurées. Chez GlobalExam, nous avons fait de cette exigence un standard.

L’IA générative ne change pas cette exigence, mais elle transforme la manière de l’appliquer à grande échelle.

Qu’est-ce qu’une explication pédagogique ?

Une explication pédagogique structure le raisonnement.

Elle ne se contente pas d’indiquer ce qui est correct ou incorrect. Elle montre comment la règle s’applique au cas précis et analyse les distracteurs en explicitant l’erreur contenue dans chaque option incorrecte. Elle adapte son niveau d’exigence au niveau visé.

Sans cette rigueur, l’explication peut rester superficielle. L’apprenant croit avoir compris, sans pouvoir réutiliser la règle dans un autre contexte.

Quand l’échelle change la nature du problème

Chez GlobalExam, près de 200 000 questions sont enrichies d’explications pédagogiques, utilisées chaque jour par des apprenants dans 7 langues.

Rédigées au fil des années par différents experts, elles reflétaient des styles et niveaux de détail variés. Certaines comportaient des imprécisions. D’autres n’analysaient pas systématiquement l’ensemble des distracteurs. Pour certaines questions, l’explication était absente.

Individuellement, ces écarts pouvaient sembler mineurs.

À grande échelle, l’hétérogénéité ne s’additionne pas : elle se multiplie. Des milliers d’explications légèrement imparfaites créent une expérience d’apprentissage instable.

À cette échelle, une revue entièrement humaine ne garantit ni homogénéité ni soutenabilité dans le temps.

Nous avons donc structuré l’usage de l’IA pour appliquer nos standards de manière systématique.

À l’ère de l’IA générative, une question s’est imposée :

Comment garantir la qualité des explications à grande échelle grâce à l’IA ?

Structurer l’IA pour appliquer nos standards

Nous avons d’abord travaillé sur un périmètre pilote clairement défini : les formats les plus utilisés dans l’apprentissage de l’anglais, QCM et textes à trous, avec des explications en français comme en anglais.

Ce pilote a porté sur plus de 70 000 explications générées et analysées, permettant d’unifier le style, le format et le niveau d’analyse, tout en corrigeant les incohérences et d’explication identifiées.

Nous avons conçu un cadre de génération IA dédié, qui contraint le modèle à appliquer nos standards pédagogiques. Nos experts formalisent les règles, les font évoluer, puis les intègrent dans les instructions données au modèle. Chaque production est ensuite contrôlée avant validation.

L’IA ne définit pas les règles. Elle les applique.

Chaque génération respecte :

- des consignes adaptées au type de question

- des critères spécifiques au niveau CECRL

- l’analyse systématique de toutes les options

- un format structuré et stable

Beaucoup utilisent l’IA pour produire plus vite. Nous l’utilisons pour produire plus rigoureusement.

Les limites révélées à grande échelle

Malgré le cadre défini, certaines limites sont apparues dans les explications générées par l’IA.

-

Mélanges de langues : Questions en anglais, explications en français ; le modèle mélangeait parfois les langues dans une même explication ou traduisait des éléments qui devaient rester en anglais.

-

Oubli de distracteurs : Au-delà de six ou sept options, certaines réponses incorrectes n’étaient pas toujours analysées.

-

Gestion des négations : Les questions demandant d’identifier la mauvaise réponse introduisent une logique inversée plus complexe à traiter pour l’IA.

Ces écarts ne remettaient pas en cause le cadre. Ils montraient qu’un pilotage plus fin était nécessaire.

Nous avons donc renforcé le contrôle qualité en combinant vérifications automatisées et validation humaine. Chaque explication est analysée sur la langue, la structure attendue, la présence de toutes les options et la cohérence logique.

Certaines productions sont validées automatiquement. D’autres sont ajustées par nos experts. Celles qui ne respectent pas nos critères sont écartées.

Contrôler les modèles IA, pas leur faire confiance

La qualité repose aussi sur des choix techniques explicites. Un modèle génératif ne devient pas fiable par défaut : il doit être paramétré, contraint et supervisé.

Nous avons donc structuré le cadre technique autour de quatre leviers :

-

Limiter les hallucinations : Les modèles génératifs peuvent produire des réponses cohérentes mais incorrectes. Lorsque l’information est insuffisante, notre système signale la limite au lieu de générer une explication approximative.

-

Réduire la variabilité : La température du modèle a été réglée à un niveau bas pour éviter les sorties divergentes ou spéculatives.

-

Stabiliser le format par few-shot prompting : des exemples de réponses attendues sont intégrés aux instructions pour cadrer la structure.

-

Human-in-the-loop : des vérifications automatisées analysent chaque production sur la langue, la structure et la cohérence logique. Seules les explications présentant un écart sont transmises en revue humaine.

Trois mois d’itérations entre équipes pédagogiques et techniques ont été nécessaires pour stabiliser le cadre.

Ce que cela change concrètement

Pour vos apprenants

L’objectif n’est pas seulement de réussir un exercice, mais de consolider durablement la compétence.

Les nouvelles explications, plus structurées et homogènes, permettent désormais de :

- comprendre précisément la règle mobilisée dans chaque question

- identifier pourquoi les autres options sont incorrectes

- repérer les pièges récurrents et éviter de reproduire les mêmes erreurs

- réutiliser la règle correctement dans de nouveaux contextes

Pour nous, et pour vous

- garantir une qualité constante d’une question à l’autre

- corriger systématiquement les incohérences et absences d’explication

- harmoniser les formats entre langues et types d’exercices

- faire évoluer les standards de manière continue et contrôlée

Innover pour mieux apprendre

Innover ne consiste pas seulement à automatiser, mais à structurer pour garantir une qualité pédagogique constante, à grande échelle, tout en maintenant l’expertise humaine au cœur du système.

C’est dans cette logique que s’inscrit le Labs de GlobalExam, au service d’une qualité pédagogique mesurable et durable.